Generativ AI för bilder och konst är här – men vad betyder det?

Ett ämne som cirkulerat friskt i medier de senaste månaderna är det här med AI-konst, eller generativ AI för bilder, som kanske är en mer korrekt benämning. Nyheten är att artificiell intelligens nu kan generera helt unika och smått fantastiska bilder och konstverk, på några sekunder. Och att den här tekniken blivit tillgänglig för allmänheten.

Att teknik som använder artificiell intelligens utvecklats under de senaste åren är det nog få som missat. Men det är ofta ett stort steg från att se coola demos från företag och att faktiskt kunna sätt sig ned och använda tekniken själv.

Så vad är det som pågår egentligen? Hur funkar det och vad får den här utvecklingen för betydelse framåt? Det tänkte jag att vi skulle gå igenom i detta inlägg!

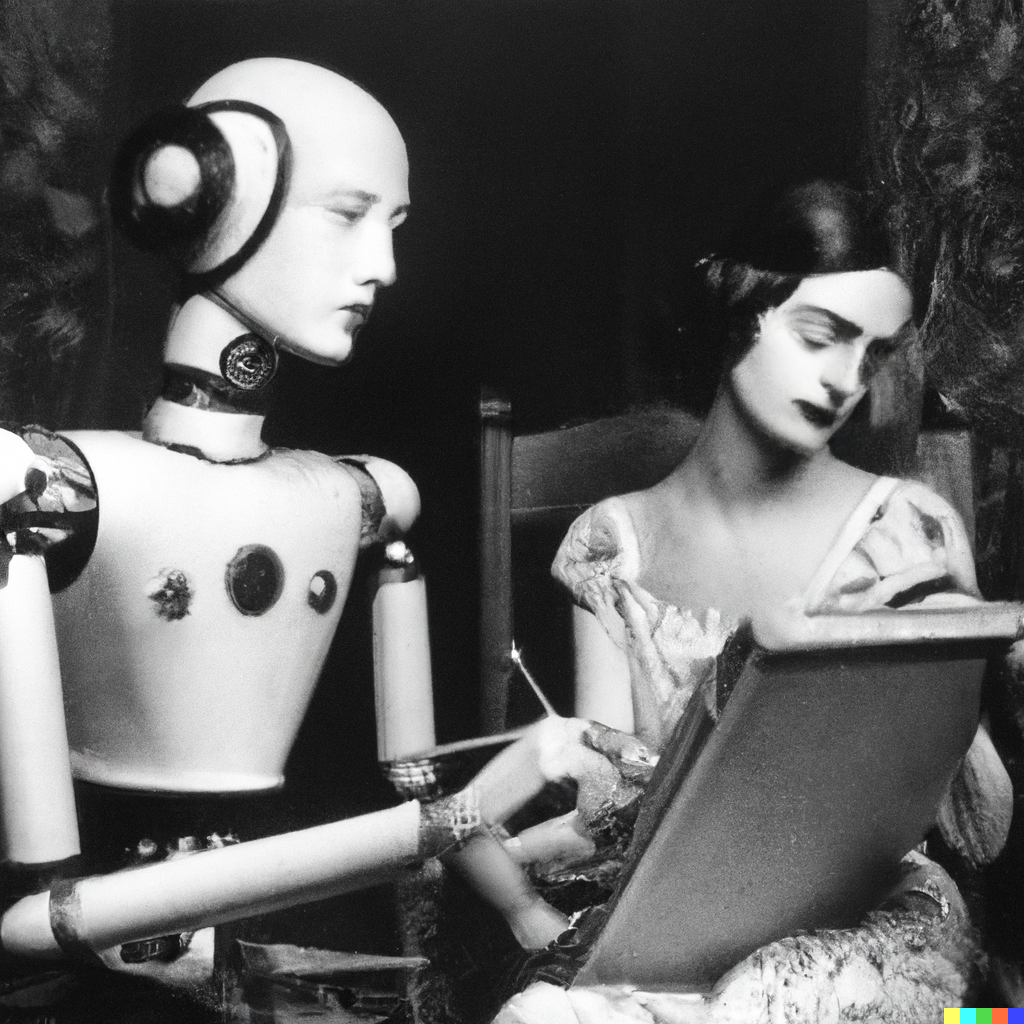

Alla bilder i det här inlägget är också genererade av mig med hjälp av de här nya AI-tjänsterna.

De nya tjänsterna där vem som helst kan generera bilder genom ord

Under bara de senaste månaderna har framförallt tre tjänster för AI-genererade bilder släppts till allmänheten: Dall-E 2, Midjourney och Stable diffusion (Stability). Men det finns fler också, och många som använder de här programmen för att bygga egna tjänster.

Alla dessa tjänster har en gemensam utformning: du skriver in ord i en textruta (det kallas prompt) och så genererar AI en eller flera bilder baserat på texten du skrivit. Ju längre, mer detaljerade och sofistikerade prompts du lär dig skriva – desto mer kontroll kan du få över resultatet.

Men även enkla prompts, som ”an iceskating banana” eller ”four bears around a table” kan generera riktigt intressanta bilder. (Detta kallas även ”raw prompts”).

Ibland är det att låta AI:n göra tolkningen av mer abstrakta begrepp som kan generera de mest drömlika och fascinerande bilderna.

I dina prompts kan du även skriva in ”styles” för att modellen ska hämta inspiration från en särskild typ av bilder eller en konstnär.

Även om resultaten ibland blir väldigt coola på direkten så kan det ofta ta många iterationer, vidareutvecklingar och noggrant formulerade prompts för att få fram det resultat man vill. Sen finns det också alltid ett element av slumpmässighet, vilket både är kul och utmanande beroende på vad man vill göra.

AI-programmen har ofta också lite problem med vissa saker. Till exempel blir ansikten ofta hoptryckta, skeva eller konstiga. Men AI-programmen utvecklas i rekordfart nu. Bara under de här veckorna som jag utforskat framförallt Midjourney har det kommit nya uppdateringar och funktioner som gör ansikten mycket mer realistiska och mindre läskiga.

Det handlar också mycket om att lära sig vad man kan skriva i sina prompts för att få bättre och mer realistiska ansikten, samt att ha tålamod och göra många iterationer på samma bild. Den ovan här tog till exempel åtminstone tre nya ”variations” i Midjourney innan ansiktena blev så här bra.

Här är ett exempel där jag använde lite grejer i min prompt som gav ett mer realistiskt ansikte i Midjourney:

Hur funkar det här egentligen?

Generativ AI är egentligen inget nytt. Det har funnits AI som kan generera dikter, böcker, mail och filmmanus sedan länge. De funkar så att man tränar en modell på ett dataset bestående av vad man vill lära AI:n att skapa, till exempel massor av dikter eller bokmanus. AI:n hittar mönster i datan och kan sedan börja generera egna texter utifrån vad den lärt sig.

Med tiden, ju mer sofistikerade de här modellerna blir och när människor hjälper AI:n genom att värdera resultaten, desto bättre och mer ”verklighetstrogna” resultat kan den generera.

Text är ju en relativt enkel form av data för en dator att förstå. Men den senaste utvecklingen har legat i att få datorn att även kunna tolka och förstå bilder.

Digitala bilder är ju egentligen data om exakt vilken färg olika pixlar har. Genom att man satt etiketter på vad olika bilder föreställer, exempelvis att en särskild sammansättning pixlar visar en hund, så kan en AI börja lära sig vilket mönster av pixlar som visar ”hund”.

Och om AI:n sen får träna på stora massiva databaser av etiketterade bilder – då kan den börja navigera i komplexiteten som är att förstå bilder. En hund kan ju till exempel ligga hoprullad med stängda ögon, eller gömma sig bakom en buske, eller vara av tusentals olika raser. Men det är fortfarande en hund.

Det skulle vara i princip omöjligt att själv skriva en algoritm till ett dataprogram som skulle kunna avgöra om en mängd random bilder föreställde ”hund” eller inte.

Men en AI kan, när den genom etiketterna får veta om något är en hund och om något inte är en hund, själv utveckla sin egen algoritm och hitta egna mönster i datan som vi människor inte ens förstår. Och varje gång vi säger om den gjorde rätt bedömning eller inte förbättrar den sin algoritm. Det är det man menar när man säger att man ”tränar” en algoritm på ett dataset.

Och när en AI blivit bra på detta kan den börja generera nya kombinationer av pixlar baserat på vad den lärt sig om hur pixlar ska sättas samman utifrån olika ord vi matar in. Så bilderna är inte kollage eller mashups av befintliga bilder. Det är helt nya, unika bilder som aldrig funnits innan, även om de kan hämta inspiration från befintliga bilder.

”Jaha så nu behövs inte konstnärer eller designers längre?”

Många tänker ju när de ser det här att ”jaha nu kan alla vara konstnärer”, och ja, till viss det är det ju så. Det här är ett ganska kraftfullt verktyg för den som inte har så artistiska skills att kunna producera häftiga och avancerade digitala bilder.

Det har såklart funnits digitala verktyg innan, som Photoshop och appar, där man kunnat skapa bilder som tidigare skulle varit väldigt svåra att åstadkomma med till exempel penna eller pensel. Nu har den här utvecklingen tagit ytterligare ett steg.

Men det blir ganska snabbt tydligt att även om de här tjänsterna är lätt att använda så är det designers och konstnärer, de som redan har en känsla för ett visuella och ett kreativt sinne, som också skapar de bästa konstverken med de här AI-verktygen.

I den här videon av amerikanska journalisten Cleo Abram visas den principen väldigt bra. Hon gör en utmaning tillsammans med en kompis som är konstnär där de använder samma verktyg och hennes tittare har sen fått rösta vilka konstverk de gillar bäst. Konstnärens bidrag vinner över hennes, både med och utan AI-verktyg.

Om det är något teknikutvecklingen har visat oss så är det att bara för att man har tillgång till samma verktyg kan man inte skapa lika professionella resultat. Om du får använda en jätteavancerad filmkamera skulle du troligen ändå göra en mer amatörmässig video jämfört med om ett filmproffs filmade med din mobilkamera. (Om nu inte du själv råkar vara filmproffs, i så fall… du fattar vad jag menar!).

Däremot så har ju olika människor olika preferenser gällande verktyg. Någon kanske älskar att rita med kol, en annan med gouache, någon är grym på att rita digitalt på iPad i Procreate, en annan är fantastisk på att skapa konst med foton i Photoshop.

Med de nya AI-verktygen kommer en ny grupp konstnärer och designers stiga fram som tilltalas av just det här verktyget. Och det häftiga är ju att det inte krävs öga-hand-koordination – vilket öppnar upp skaparmöjligheterna för personer som tidigare kanske haft svårt att uttrycka sig visuellt.

Så de nya tjänsterna är redan, och kommer att bli, ett verktyg som en del konstnärer och designers kommer använda sig av i sitt skapande. Och såklart personer som aldrig sysslat med konst innan men som faller för just de här verktygen och upptäcker sin skaparlust.

De som verkligen ger sig in på att förstå, behärska och hitta ny spännande användningsområden för de här AI-tjänsterna kommer antagligen också få en fördel på arbetsmarknaden framöver eftersom de kommer kunna generera AI-bilder med hög kvalité på ett snabbt och kostnadseffektivt sätt. En kompetens som troligen kommer bli efterfrågad framöver!

Konstnärers unika stil blir plagierad

Som användare är det ju väldigt kul att kunna knappa in namnen på olika konstnärer för att AI:n ska ”inspireras” av deras verk och skapa en bild i samma stil.

För konstnärer som lever idag är det mindre kul.

Generativ AI lär sig ju via befintliga bilder. Och personer som genererar bilderna kan lära sig vilka namn som man kan knappa in för att få bättre resultat. För vissa konstnärer känns ju det här väldigt mycket som plagiat – även om deras bilder inte blir direkt kopierade så blir ju deras stil det.

Företagen bakom de här tjänsterna jobbar på olika sätt som man som konstnär ska kunna ”opt out” från att ha sina bilder med i det dataset med bilder som AI:n hämtar från. Vilket kan vara en typ av lösning. Men som alltid med ny teknik så löser man något problem samtidigt som man skapar nya.

Upphovsrätt är ju redan som det är en ganska snårig business. Till exempel så äger jag upphovsrätten till bilder jag genererar med Midjourney, eftersom jag är betalande kund. Men samtidigt känns det ju inte riktigt som att jag har skapat bilderna. Denna fråga blev akut aktuell när en person vann en konsttävling med ett verk skapat just tillsammans med Midjourney (vilket han var öppen med från början, men som ändå skapade mycket debatt).

Den här debatten kring konstnärer vs generativ AI för bilder kommer nog rulla på några år framöver.

Men tänk om man får AI:n att generera en bild av något riktigt riktigt hemskt?

Ja, det här är ju såklart också ett problem som direkt dyker upp i den offentliga debatten. Vi har redan hört den länge gällande tekniken att skapa ”deep fakes”, AI-genererade videoklipp där man kan få det att se ut som att en känd person deltar i till exempel en porrfilm, eller att en politiker säger något helt galet.

Än så länge har rädslan och oron kring deep fakes varit mycket större än problem med verklig användning av deep fakes. Men ny teknik leder alltid tid ny oro (och nya problem).

När det gäller tjänsterna för AI-genererade bilder har de flesta innehållsfilter pålagda som förhindrar att man skapar våldsamt, pornografiskt och på andra sätt stötande innehåll.

Den mest öppna av tjänsterna, Stable diffusion, är open source och vem som helst kan egentligen ladda ned tjänsten och avinstallera innehållsfiltren. Men även om de kan skapa uppseendeväckande och hemska bilder så finns det ju få platser där dessa kan laddas upp och spridas, eftersom plattformar som sociala medier och bilduppladdningstjänster redan har avancerade innehållsfilter.

VD:n fär Stable diffusion sägger i podden Hard Fork att de lagt 10 gånger så mycket pengar på att skapa programvara som kan identifiera AI-genererade bilder som de lagt på Stable diffusion. På så vis hoppas de kunna hjälpa till att identifiera fejkade bilder i framtiden.

Några tankar om framtiden, jobb, stockfoton, Pinterest och Metaverse

Ny teknik medför alltid att vissa jobb eller yrkesroller riskerar att förändras eller effektiviseras bort på kort sikt. Historien av digitalisering har dock visat att nya yrken eller jobbuppgifter också skapas genom utvecklingen. Så även om det är jobbigt i stunden brukar de flesta ändå tycka att utvecklingen är positiv i långa loppet.

De som först kanske behöver utveckla sitt företagande är tjänster som tillhandahåller stockfoto. Stockfoton är ju redan lite av en nödlösning för de som behöver visuellt material men som inte har tid, råd eller kunskap att skapa eller beställa det själva.

Nu när vi kan använda AI för att snabbt generera mer unika och intressanta bilder till våra Power point-presentationer, sociala medier-konton och hemsidor kan vi slippa använda samma tråkiga, generiska stockbilder. Det tror jag är positivt!

Ett område där AI-genererade bilder redan börjat användas är för att skapa bokomslag. Det ges ju ut enorma mängder böcker, och bokbranschen jobbar alltid med små marginaler. Visst, stora förlag kan ta in professionella designers och konstnärer för att göra bokomslag. Men små förlag eller de som ger ut egna böcker får ofta nöja sig med omslag i låg kvalité. Och det är just i de sistnämnda fallen som AI-genererade bilder redan öppnat för nya möjligheter.

Än så länge kanske det är mest de som är särskilt intresserade som använder de här tjänsterna men Microsoft har redan berättat att man kommer bygga in Dall-E 2 i sin nya designer-tjänst (en sorts svar på den populära tjänsten Canva). Och det står nog inte på förrän de kompletterar stockfoto-biblioteket i resten av Office-sviten med Dall-E.

Om några år tror jag inte ens vi kommer reflektera över om en bild är något vi sökt fram eller något som genererats för oss i stunden.

Det skapar också en intressant fråga om Pinterest. Om Pinterest med AI kan börja generera ett oändligt antal unika, inspirerande bilder utifrån vad vi söker på eller gillar – kommer det göra tjänsten bättre eller sämre?

Spontant känns det ju ganska dystopiskt och deprimerande. Men mycket av inspirationen vi hittar på sociala medier eller Pinterest är ju redan till stor del ”fejk”, utifrån att det är iscensatt, redigerat osv. Så var går gränsen? Kommer vi ens märka någon skillnad? Hur viktigt är det om den där inspirerande inredningen, outfiten eller tårtan någonsin existerat i ”verkligheten”?

Samma sak kan man ju fråga sig gällande sociala medier. Det finns ju redan AI-influencers som Lil Miquela (med över 2,9 miljoner följare på Instagram) som ifrågasätter hur viktigt det är med en verklig person bakom ett influencer-konto. Kommer det bli en grej att ha typ ”AI-märkning” av sociala medier-innehåll om några år? Det ska bli spännande att se.

Och vi kommer inte stanna vid bilder. Företagen bakom de här bildgeneratorerna jobbar redan på generativ AI för video. Vilket kommer skapa ytterligare ett stort hopp framåt.

Och den här utvecklingen är avgörande för uppbyggnaden av det som kallas ”metaverse”, visionen av framtidens internet som en immersive 3D-värld. För att det ska bli ekonomiskt hållbart och rimligt att bygga den världen kommer det vara viktigt att snabbt och enkelt kunna skapa visuella miljöer.

Detta är bara början…

Sugen på att testa att generera bilder med hjälp av AI?

Dall-E 2 är väldigt enkel att signa upp på gratis och testa, till exempel med ett Google- eller MIcrosoft-konto. Du får ett antal ”credits” gratis vid starten, och nya varje månad. Credits krävs för att generera bilder och du kan betala för att köpa fler om du vill.

Även Midjourney kan du registrera dig på gratis (”Join Beta”). Men för att göra det behöver du ha ett Discord-konto. Discord är en tjänst för att ha olika community-chattar, så inget skumt alls. När du har ett konto och kopplar det till Midjourney bjuds du in till deras Discord-kanal. Där finns det ”newbie”-rum (som heter typ #newbie-134), och där kan du gå in och skriva ”/imagine” för att starta Midjourneys bot och sen kan du skriva din prompt. Det är några moment att sätta sig in i om det här med Discord och bottar är nytt, men det är egentligen inte så svårt. Du får några bildgenereringar gratis, sen får man betala en månadskostnad om man vill fortsätta. Jag betalar för 200 genereringar per månad, då kan jag även använda botten ”anonymt” i Discords DM istället för öppet i chattrummen.

Stable Diffusion är egentligen open source, det vill säga gratis, för den som vill gå igenom processen att sätta upp den på datorn (vilket involverar att ladda ned från Github och köra det i en särskild pythonmiljö etc). Men de har även en webbtjänst som heter DreamStudio. Om du signar upp får du även där några gratis försök, men sen får du betala för fler credits. Det är även genom ett konto där som du kan hämta den API-nyckel som behövs för att använda Stable diffusion om plugin till Photoshop, som jag gör.

Ha så kul! 🤖👩🎨🖌️

Prenumerera på Teknifik

Teknifik är nyhetsbrevet och bloggen för dig som vill inspireras till en smartare och enklare digital vardag. Nyhetsbrevet är för närvarande vilande, men sporadiska inlägg kan dyka upp. Som prenumerant får du nya inlägg direkt till din inkorg.

Denna prenumeration är gratis och du kan avsluta när du vill.

16 reaktioner på ”Generativ AI för bilder och konst är här – men vad betyder det?”

Oh vad spännande! Hade ingen aning om att det gick göra med en app bara. Tack!

Kul att få introducera något nytt! 🙂

Såå spännande! Det här ska jag titta närmre på och sätta mig in i lite mer. Stort tack för din grymma sammanställning.

Vad kul att höra, tack snälla. Ja, att få koll på detta tidigt kommer vara en stor fördel framöver, anser jag.

Hej Elin!

En mycket spännande utveckling, det här är förmodligen bara början.

Jag undrar dock en sak.

Vem är bakom dessa tjänster, således vem äger dessa tjänster.

Mvh Danny

Hej Danny!

Det är privata bolag som äger dem, vilket ju såklart har sina nackdelar.

Open AI heter företaget som äger Dall-E 2, Midjourney äger Midjourney och företaget Stability äger Stable diffusion.

Jag har testat Stable Diffusion Online och blir förbluffad av AI:s fantasi. Skriver samma text och uppdaterar flera gånger och får både liknande och olika bilder.

Men Oscar Reutersvärds omöjliga figurer förstår sig inte AI:n på.

Håller med, det är verkligen fascinerande att se hur AI:n ”tänker”. Väldigt poetiskt för att vara så tekniskt. 🙂

Skönt att hör att tekniken fortfarande har några begränsningar iallafall 😌

Så otroligt coolt! Tack för ett intressant inlägg!

Kul att du uppskattade det! TACK!

Vilket fantastiskt bra inlägg, Elin! Tack! Blev så inspirerad så jag blev tvungen att testa Dall-E på en gång. Som konsult och kreatör känner jag mig faktiskt inte stressad av AI, tvärtom. Har suttit ett tag och bråkat med bildmaterial till en webbplats som kräver schyssta bilder för att illustrera cybersäkerhet et cetera – visade sig att det funkade strålande att fixa till futuristiska cyberattacker i Dalle-E! Kommer definitivt att läggas till bland mina framtida arbetsverktyg 🙂

Vad kul att höra! Ja men för många mer abstrakta grejer man behöver bildsätta är ju AI ganska otroligt som verktyg faktiskt. 😀

Jag tycker att Discord och liknande tjänster är kul att leka med men människorna ser ofta riktigt obehagliga ut. Även då man ger inputen att de ska se verkliga ut. Det är något väldigt omänskligt över dessa bilder. Fast coolt, ja.

Ja, helt klart har de lite problem med ansikten. Men tycker det blir bättre och bättre hela tiden. Lär man sig lite bra nyckelord att skriva in också får man bättre porträtt, t.ex. ”Canon EOS” tycker jag har funkat för att få mycket mer realistiska närbilder iallafall. Kolla in @annikan.ai på Instagram, hon är grym på att få till ansikten!

Tack för bra och pedagogiskt inlägg! Super!

Hur är det med rättigheter för de bilder man genererar då, är det fritt att använda bilderna hur man vill? I kommunikation och marknadsföring också?

Det varierar från plattform till plattform, och beroende på vilket abonnemang man har. Man får generellt använda bilderna men med vissa förbehåll, så det gäller att läsa på lite vad som gäller.